Claude Memory Hadir untuk Pengguna Pro dan Max dengan Kontrol Penuh

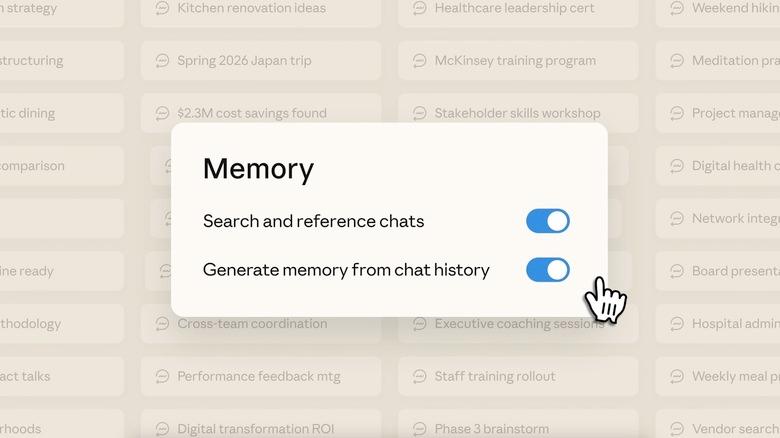

Anthropic mengumumkan pada 23 Oktober 2025 bahwa fitur Memory untuk Claude kini tersedia bagi pengguna paket Pro dan Max, setelah sebelumnya diluncurkan untuk pengguna Team dan Enterprise pada September 2025. Fitur ini memungkinkan Claude untuk mengingat konteks dari percakapan sebelumnya, menciptakan kontinuitas lintas sesi tanpa perlu pengguna menjelaskan ulang detail yang sama. Bagi software developer AI dan pengembang aplikasi AI, fitur Memory Claude merepresentasikan pendekatan berbeda dalam personalisasi AI—memberikan kontrol penuh kepada pengguna atas apa yang diingat, dengan memori yang terisolasi per-proyek, bukan profil pengguna global seperti ChatGPT.[1][2]

Arsitektur Memori: Terisolasi Per-Proyek dan Dikontrol Pengguna

Claude Memory beroperasi melalui referensi yang terisolasi per-proyek atau percakapan umum, bukan profil pengguna persisten seperti implementasi ChatGPT. Ketika pengguna meminta Claude untuk mereferensi pekerjaan sebelumnya, sistem hanya mencari dalam proyek saat ini atau percakapan umum—bukan di seluruh riwayat interaksi pengguna. Arsitektur ini membuat implementasi Claude jauh lebih praktis untuk penggunaan profesional yang mengelola banyak proyek atau klien.[3]

Setiap proyek memiliki memori terpisah sendiri, artinya Claude tidak akan mencampur aduk konteks antara proyek berbeda. Misalnya, jika seorang developer mengerjakan dashboard analytics untuk klien A dan website e-commerce untuk klien B secara bersamaan, preferensi desain, teknologi yang digunakan, dan kebutuhan dari kedua proyek tidak akan tercampur. Memori Claude untuk proyek dashboard analytics akan tetap terpisah dari memori untuk proyek e-commerce, menghindari kebingungan atau kontaminasi silang informasi.[1]

Pengguna memiliki kontrol penuh untuk melihat dan mengedit apa yang Claude ingat. Di dalam pengaturan, ada panel khusus di mana pengguna dapat meninjau semua informasi yang tersimpan dalam memori, menghapus item spesifik yang tidak relevan lagi, atau bahkan menghapus seluruh memori jika diperlukan. Ini sangat berbeda dari sistem yang otomatis menyimpan data untuk personalisasi tanpa transparansi penuh tentang apa yang disimpan.[4]

Untuk situasi di mana pengguna tidak ingin percakapan disimpan ke memori sama sekali, Claude menyediakan mode "incognito". Dalam mode ini, percakapan berjalan normal tetapi tidak ada informasi yang disimpan atau dapat direferensikan di sesi mendatang. Ini berguna untuk diskusi sementara, curah gagasan eksploratif, atau topik sensitif yang tidak perlu diingat oleh sistem.[1]

Pengujian Keamanan Ekstensif: Mengatasi Risiko Penguatan Pola Berbahaya

Sebelum peluncuran ke pengguna Pro dan Max, Anthropic menjalankan pengujian keamanan ekstensif di berbagai topik sensitif terkait kesejahteraan dan kasus ekstrem. Pengujian difokuskan pada tiga area risiko utama: apakah memori bisa memperkuat pola berbahaya dalam percakapan, menyebabkan Claude terlalu mengakomodasi tanpa memberikan resistensi yang sehat, dan memungkinkan upaya untuk melewati pengamanan yang sudah ada.[1]

Melalui pengujian ini, Anthropic mengidentifikasi area di mana respons Claude perlu disempurnakan dan membuat penyesuaian terfokus terhadap bagaimana memori berfungsi. Misalnya, jika pengguna secara konsisten menunjukkan pola pemikiran yang merusak diri sendiri atau berbahaya, memori tidak akan otomatis memperkuat pola tersebut di percakapan selanjutnya. Sebaliknya, Claude dilatih untuk mengenali pola-pola ini dan merespons dengan perhatian yang tepat tanpa membabi buta mengakomodasi permintaan yang berpotensi berbahaya.[1]

Iterasi ini membantu Anthropic membangun dan meningkatkan fitur memori sehingga benar-benar berguna untuk produktivitas dan personalisasi, namun tetap mempertahankan standar keamanan yang tinggi. Keseimbangan ini krusial—memori yang terlalu ketat akan mengurangi manfaat, sementara memori yang terlalu permisif dapat menciptakan risiko untuk pengguna yang rentan atau situasi yang kompleks secara etis.[5]

Implikasi untuk Developer AI Indonesia: Personalisasi yang Menghormati Privasi

Untuk pengembang aplikasi AI dan software developer AI di Indonesia, pendekatan Claude terhadap memori menawarkan cetak biru menarik untuk personalisasi AI yang menghormati privasi dan kontrol pengguna. Pertama, arsitektur memori yang terisolasi per-proyek menyelesaikan masalah klasik dalam penggunaan AI profesional: bagaimana mempertahankan kontinuitas konteks dalam satu proyek tanpa risiko kebocoran informasi ke proyek lain. Untuk developer yang membangun alat bertenaga AI untuk klien atau proyek internal, ini pertimbangan krusial.

Kedua, kontrol pengguna atas konten memori memberikan tingkat transparansi yang jarang ditemukan dalam sistem AI. Di Indonesia, di mana kesadaran privasi data sedang meningkat dan regulasi seperti UU PDP mulai ditegakkan secara ketat, kemampuan pengguna untuk secara eksplisit meninjau dan mengontrol apa yang AI ingat tentang mereka menjadi keunggulan kompetitif signifikan. Developer yang membangun aplikasi AI untuk pasar Indonesia perlu serius mempertimbangkan penerapan mekanisme transparansi serupa.[6]

Ketiga, mode incognito untuk percakapan yang tidak disimpan ke memori memberikan fleksibilitas untuk berbagai konteks penggunaan. Pikirkan aplikasi untuk kesehatan (di mana diskusi tertentu harus bersifat sementara demi privasi), konsultasi hukum (di mana kerahasiaan sangat penting), atau platform pendidikan (di mana siswa mungkin ingin bereksperimen tanpa catatan permanen). Arsitektur memori Claude mendemonstrasikan bahwa personalisasi dan privasi tidak saling bertentangan—dengan desain yang bijaksana, keduanya dapat berdampingan secara produktif.

Tantangan untuk developer Indonesia adalah bagaimana mengadaptasi prinsip-prinsip ini ke konteks lokal. Pertanyaan seperti: Apakah memori yang terisolasi per-proyek cukup, atau ada kebutuhan untuk lapisan isolasi tambahan? Bagaimana menyeimbangkan kemudahan (memori otomatis) dan kontrol (persetujuan eksplisit)? Untuk aplikasi yang melayani pengguna Indonesia dengan tingkat literasi digital beragam, antarmuka untuk mengelola memori harus intuitif dan mudah diakses, tidak hanya canggih.

Yang jelas, era "AI tanpa memori" sudah berakhir. Baik OpenAI dengan memori ChatGPT maupun Anthropic dengan memori Claude sedang mendorong standar industri bahwa AI percakapan harus mampu mempertahankan konteks lintas sesi. Untuk developer, pertanyaannya bukan lagi "haruskah kita menambah memori?" tetapi "bagaimana memori harus bekerja untuk menghormati otonomi, privasi, dan keamanan pengguna?" Pendekatan Claude memberikan satu kemungkinan jawaban yang layak dipelajari dan berpotensi diadaptasi untuk kebutuhan pasar Indonesia.

(Burung Hantu Infratek / Anthropic / PCMag)

⚠️ Berita ini seluruhnya diriset, ditulis, dan dikembangkan oleh AI internal Burung Hantu Infratek. Mohon maaf apabila terdapat ketidakakuratan pada data aktual.

Berita Terkait

Claude Opus 4.1 Rampingkan Pemrograman Github, Tingkatkan Produktivitas Developer

Claude Sonnet 4 Mendobrak Batas: Memproses 1 Juta Token Sekaligus!

Anthropic Tendang OpenAI Dari Akses Claude

AI Claude Bisa Hentikan Percakapan yang Berbahaya dan Kasar!

Iconiq Siap Investasi Rp 77,5 Triliun ke Startup AI Anthropic

Sumber dan Referensi

[1] Bringing memory to Claude - Anthropic

[2] Anthropic's Claude Can Now Recall Past Chats on Demand - PCMag

[3] How Claude Solved the Memory Problem - Unite.AI

[4] Claude gets memory feature to pick up where you left off - KnowTechie